來源:量子位

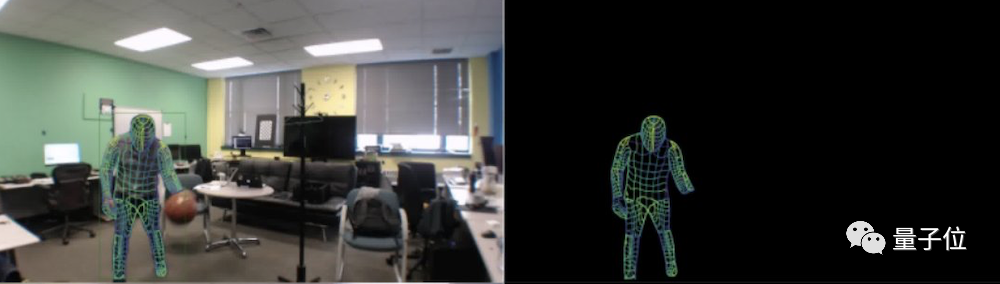

現(xiàn)在,只用WiFi就能“看”到你在房間里干啥了……

(你…干…嘛……啊啊啊啊)

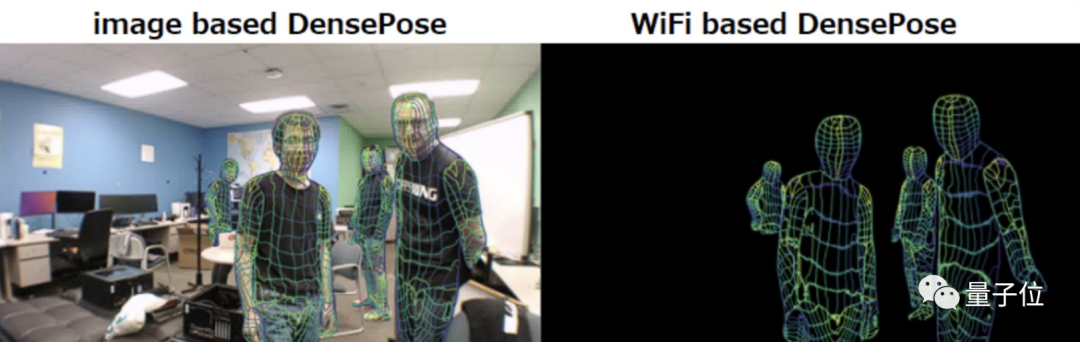

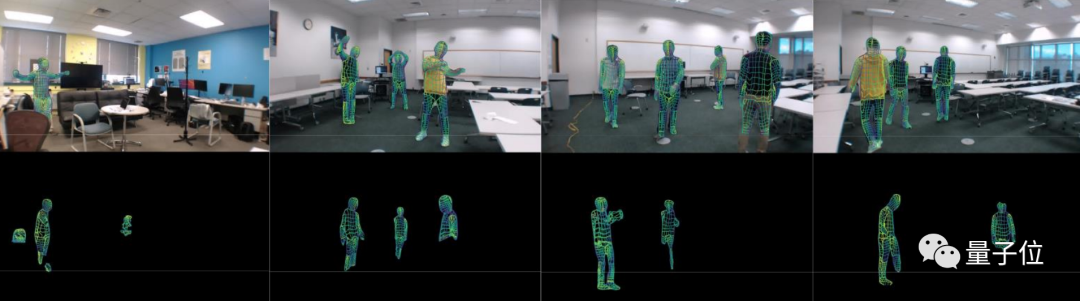

多人追蹤也是so easy:

過程中完全不需要拍下圖像、不需要攝像頭。

輸入的僅是WiFi一維信號,輸出則是三維人體姿態(tài)。

兩臺路由器即可搞定!換算成本都不到500塊。

而且還不受環(huán)境光線、目標(biāo)被遮擋的影響,效果接近于基于2D圖像進(jìn)行識別的方法。

啊這,難道說WiFi能“看到”我?更進(jìn)一步……WiFi能監(jiān)視我??

OMG,蝙蝠俠劇情要照進(jìn)現(xiàn)實(shí)了??

要知道在《暗黑騎士》里,哥譚市所有人的手機(jī)都變成了監(jiān)控設(shè)備,同一空間里所有人的一舉一動(dòng)都能被實(shí)時(shí)記錄。

網(wǎng)友們已經(jīng)構(gòu)思恐怖腦洞了:

想象一下,只需一臺連接WiFi接收器的電視機(jī),別人就能看到我們?nèi)以诟缮读恕?/span>

有人甚至說,以后可能必須要在身上涂保護(hù)層來屏蔽WiFi信號。

搞全身追蹤,不要用攝像頭了

如上提到的方法,是卡耐基梅隆大學(xué)(CMU)機(jī)器人研究所的新成果。

研究的本身目的是為了保護(hù)隱私,畢竟在很多非公共場所,如養(yǎng)老院、獨(dú)居老人家中,監(jiān)控非常有必要,但是使用攝像頭又很難保證隱私安全。

使用雷達(dá)倒是能解決隱私問題,但價(jià)格和具體可操作上就很勸退了。

于是,該團(tuán)隊(duì)想到了用現(xiàn)在幾乎各家必備的WiFi來進(jìn)行識別。

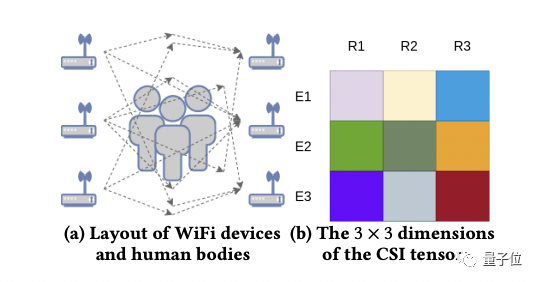

所以在設(shè)備上,僅需兩臺再也普通不過的家用路由器(每個(gè)至少有3根天線)就可以了。

原理也很簡單,就是利用WiFi信號中的信道狀態(tài)信息(CSI)數(shù)據(jù)。

這些數(shù)據(jù)是一堆復(fù)雜的十進(jìn)制序列,可以表示發(fā)射信號波和接收信號波之間的比率。

當(dāng)它們在發(fā)射器和接收器之間傳輸時(shí),一旦接觸到人體,就會被修改。

于是,通過解讀這些“改變”,就可以檢測到人體姿態(tài)。

為此,研究人員開發(fā)了一個(gè)“基于區(qū)域”的卷積神經(jīng)網(wǎng)絡(luò)分析pipeline,該pipeline可以定位人體的各個(gè)部位。

然后再將WiFi信號的相位和振幅映射到24個(gè)人體區(qū)域里的坐標(biāo),實(shí)現(xiàn)最終的全身姿態(tài)追蹤。

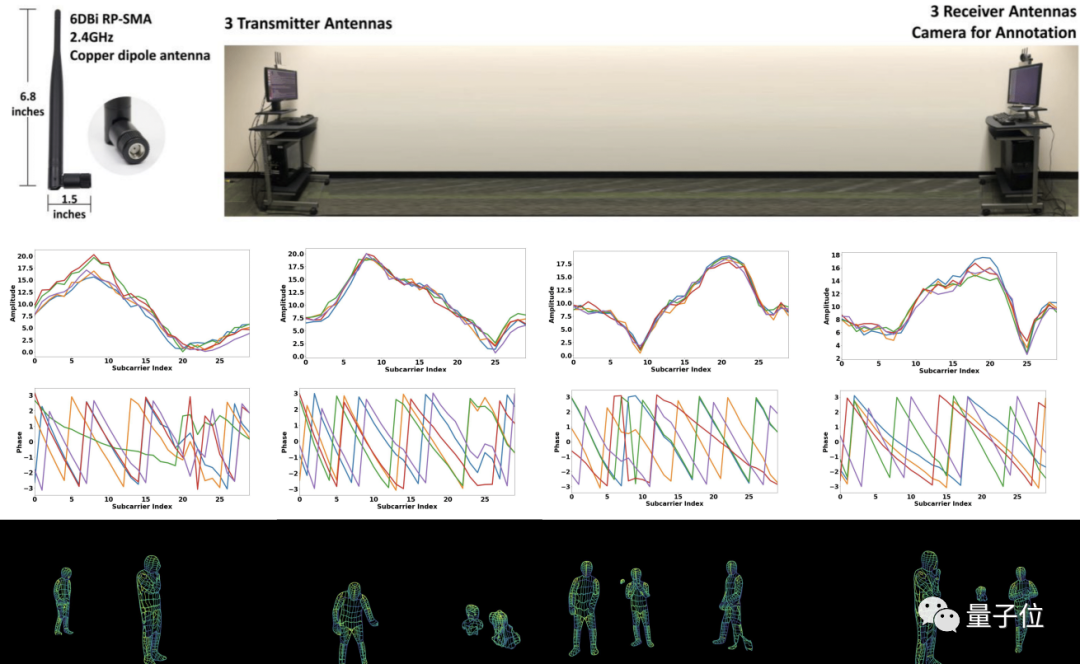

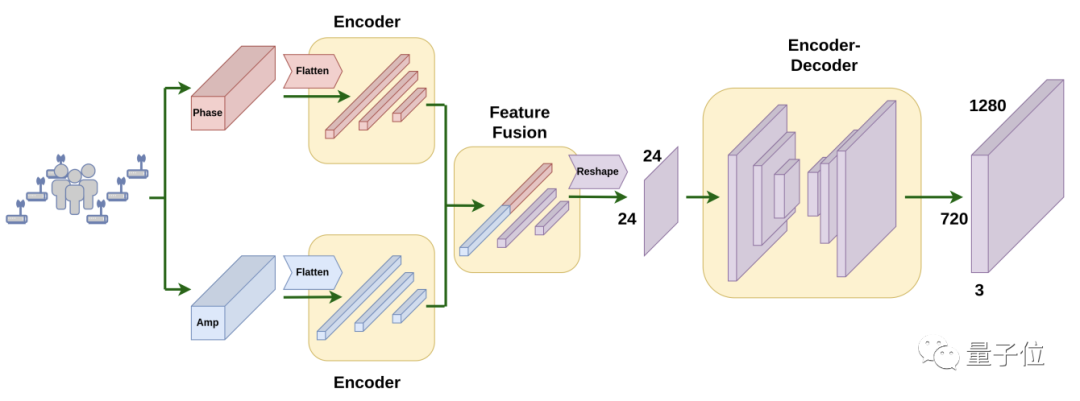

具體來說,模型通過三個(gè)分量從WiFi信號中生成人體表面的UV坐標(biāo)。

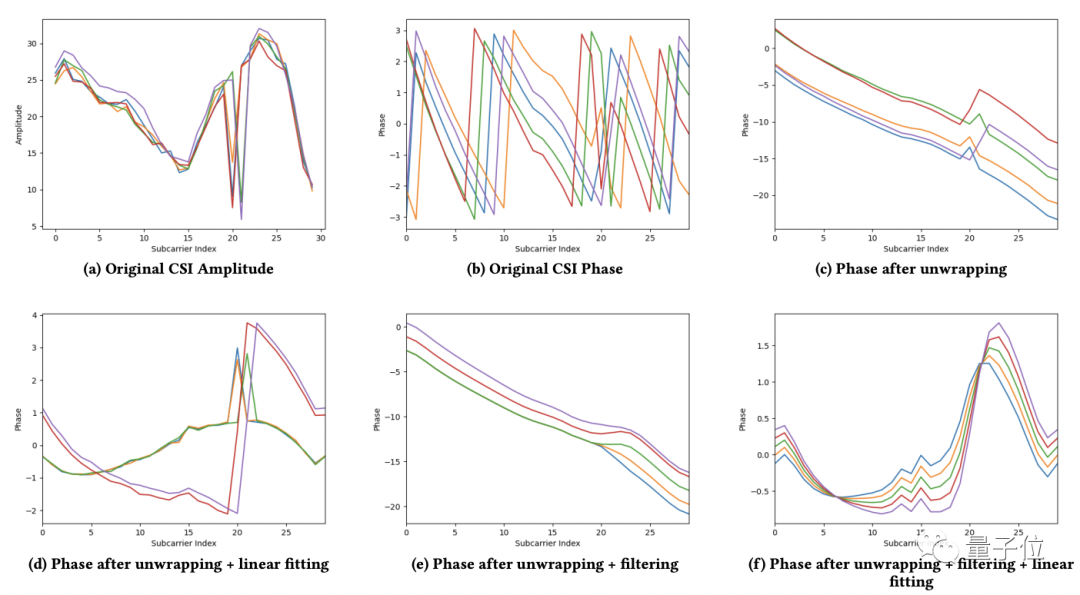

首先,通過振幅和相位Sanitization步驟對原始CSI信號進(jìn)行“凈化”處理。

然后,將處理過的CSI信號通過雙分支編碼器-解碼器網(wǎng)絡(luò)轉(zhuǎn)換為2D特征圖。

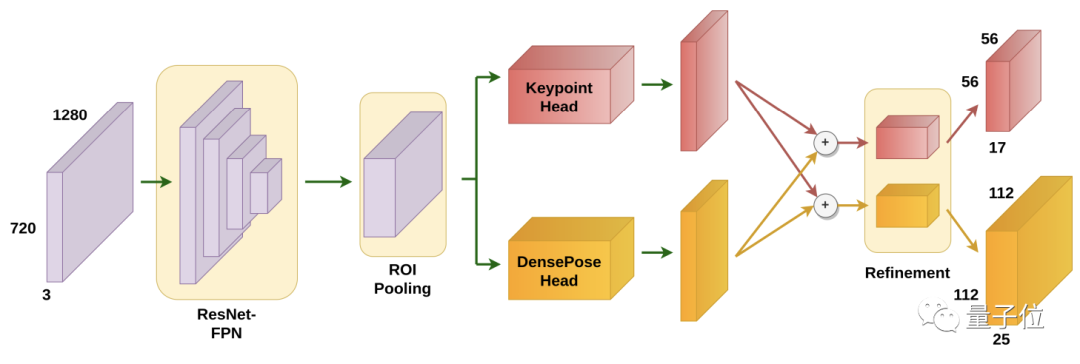

接著,將2D特征饋送到一個(gè)叫做DensePose RCNN的架構(gòu)中。

該架構(gòu)靈感就來自Facebook已經(jīng)開源的人體姿勢實(shí)時(shí)識別系統(tǒng)DensePose。DensePose入選了2018年CVPR的Oral環(huán)節(jié),主要是把2D圖像轉(zhuǎn)換成3D人體模型。

所以這步的目的就是算出2D特征圖對應(yīng)的3D姿態(tài),也就是估計(jì)出UV坐標(biāo)。

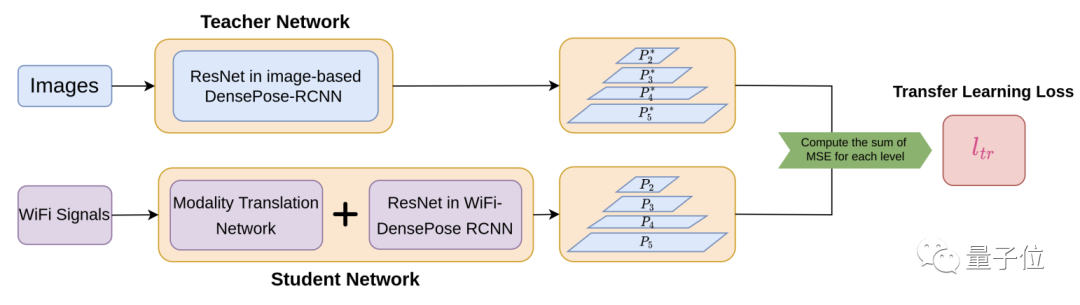

最后,在訓(xùn)練主網(wǎng)絡(luò)之前,作者還將用圖像生成的多層次特征圖與WiFi信號生成的多水平特征圖之間的差異進(jìn)行了最小化,進(jìn)一步完善了最終結(jié)果。

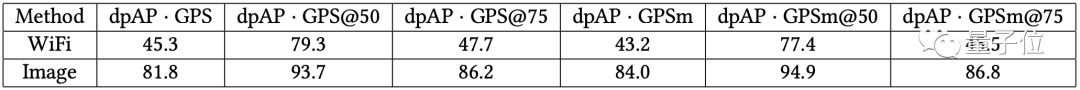

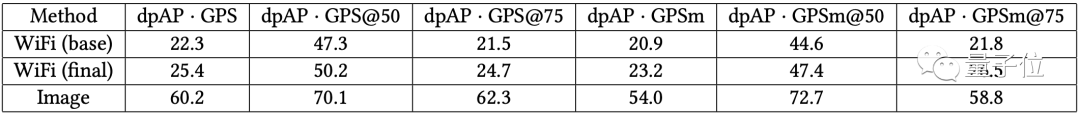

盡管我們從肉眼看上去,兩種方法的最終結(jié)果差不多,但在數(shù)據(jù)方面,基于圖像的方法效果還是更好一些。

比如在同樣環(huán)境布局下,基于WiFi方法的精確度都低于圖像方法。

△數(shù)值越高意味著越好

不同環(huán)境布局的情況也是如此。

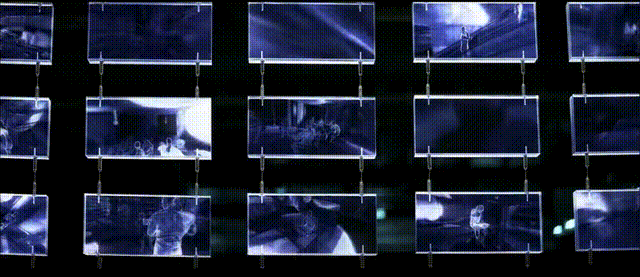

與此同時(shí),如果遇到數(shù)據(jù)集中不包含的動(dòng)作,該方法也無法識別成功。如果人數(shù)超過3個(gè),也發(fā)生“丟人”情況。

下圖中左邊兩幅是罕見動(dòng)作失敗案例,右邊兩幅是3人以上識別失敗情況。

不過團(tuán)隊(duì)認(rèn)為,如上問題可以通過進(jìn)一步擴(kuò)充數(shù)據(jù)集來解決。

除此之外,該方法對路由器的放置位置要求很高,并且會對其他WiFi網(wǎng)絡(luò)造成影響。

來自CMU團(tuán)隊(duì),有2位華人作者

論文一作為Jiaqi Geng,他來自卡耐基梅隆大學(xué),去年8月獲得了機(jī)器人專業(yè)碩士學(xué)位。

△Jiaqi Geng

另一位華人作者是Dong Huang,他現(xiàn)在是卡耐基梅隆大學(xué)高級項(xiàng)目科學(xué)家。

△Dong Huang

他的研究方向一直都是利用深度學(xué)習(xí)進(jìn)行信號識別。比如之前已經(jīng)實(shí)現(xiàn)了用WiFi信號實(shí)時(shí)識別2D人體姿態(tài)。

最后一位作者是Fernando De la Torre,他現(xiàn)在卡耐基梅隆大學(xué)機(jī)器人研究所副教授。

△Fernando De la Torre

他的研究方向主要為計(jì)算機(jī)視覺,涉及領(lǐng)域包括人體姿態(tài)識別、AR/VR等。

2014年曾創(chuàng)辦過一家開發(fā)人臉識別技術(shù)的公司FacioMetrics LLC,2年后被Facebook收購。

作者團(tuán)隊(duì)表示,目前該方法性能還受限于可用來訓(xùn)練的數(shù)據(jù)不多,未來,他們計(jì)劃擴(kuò)充數(shù)據(jù)集。

論文地址:

https://arxiv.org/abs/2301.00250

原文鏈接:https://mp.weixin.qq.com/s/scIsYPDDDRu94Vk3P5_gUg